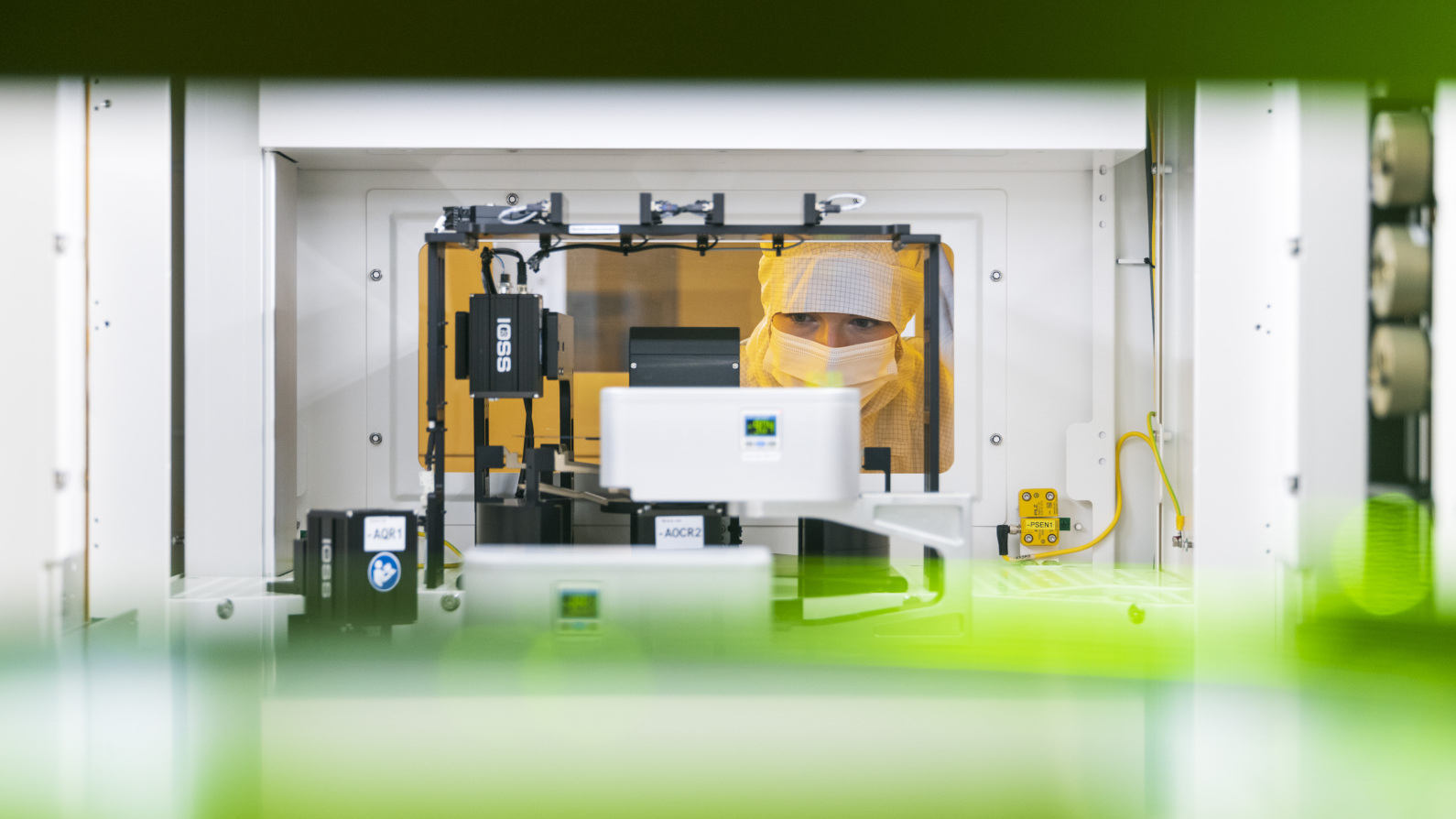

Für Entwickler von leistungsfähigen Visionsystemen ist neben den passenden Schnittstellen ein genauso wichtiger Punkt die interne Systemarchitektur, die durchgängig ausreichend Bandbreite und Performance für die Datenverarbeitung sicherstellen muss. Besonders bei Multi-Kamera-Anwendungen, bei denen viele verschiedene Schnittstellen gleichzeitig genutzt werden, spielt dies eine wichtige Rolle. Aber auch der zunehmende Einsatz von KI-basierter Auswertung darf nicht außer Acht gelassen werden. Neueste Prozessorgenerationen wie die 11.Generation der Intel Core und Xeon Prozessoren (Tiger Lake H) stehen seit kurzem auch für Embedded-Anwendungen zur Verfügung und bieten eine Vielzahl an High-Speed-Schnittstellen sowie hohe CPU- und Grafik-Leistung inklusive effizienter KI-Unterstützung. Ebenso ist die notwendige Bandbreite für schnellen DDR4-3200-Speicher gegeben. Gerade im High-End-Vision Bereich sollte das Augenmerk auf der sogenannten H-Serie liegen, wie sie auf dem Embedded Modul TQMx110EB von TQ-Systems zum Einsatz kommt. Diese bietet gegenüber der kleineren U-Serie deutlich mehr Systemperformance und den vollen Schnittstellenumfang.

Modulares Lösungskonzept

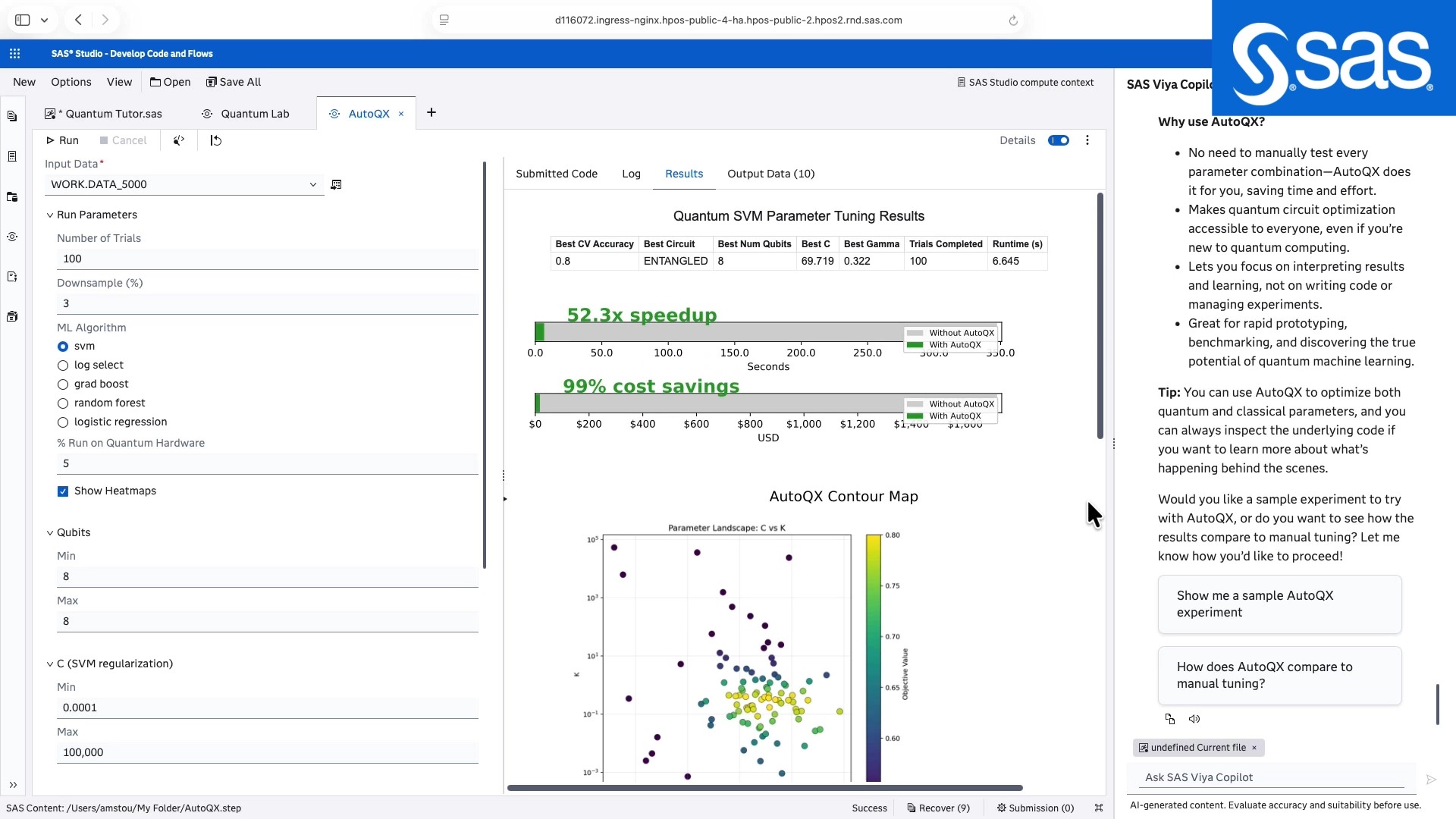

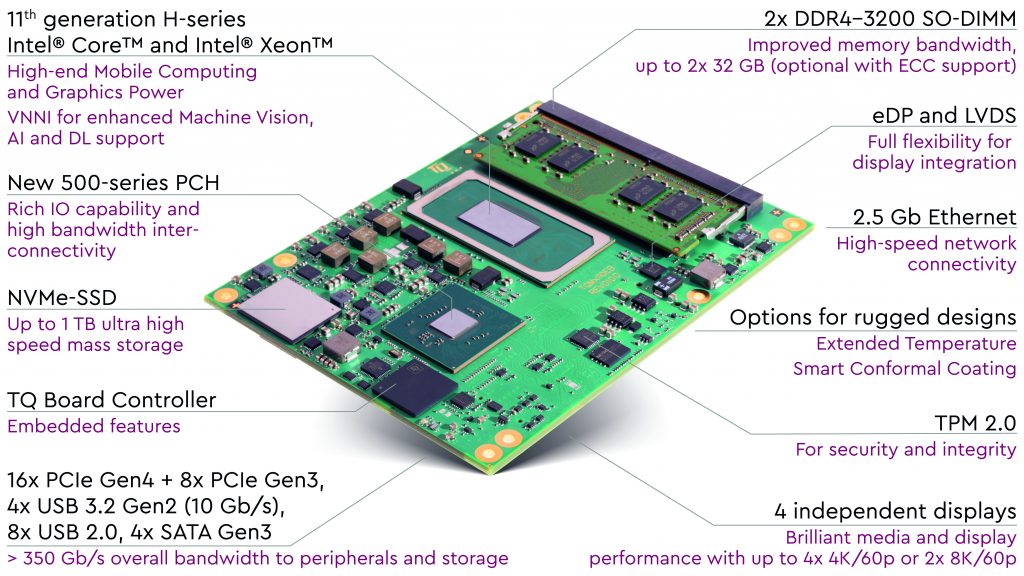

Das COM-Express-Basic-Modul unterstützt alle Embedded-H-Serie-Prozessorvarianten (Core i3, Core i5, Core i7 und Xeon) der neuen CPU-Generation. Somit stehen bis zu acht CPU-Cores, ein hoch performanter Grafik-Controller, bis zu 24MB Cache und 64GB DDR4-3200 zur Verfügung. Über die COM-Express Steckverbinder werden 2.5GigE, vier USB 3.2 Gen2 Schnittstellen (mit je 10Gbit/s), acht USB 2.0 Interfaces sowie vier SATA III Ports bereitgestellt. Das Modul bietet zusätzlich 24 PCIe Lanes, wobei diese in zwei Gruppen aufgeteilt sind: Acht PCIe Gen3 Lanes mit je 8Gb/s werden über den PCH (Peripheral Controller Hub/Chipsatz) bereitgestellt und teilen sich die Bandbreite zur CPU mit den anderen IO-Schnittstellen. Die weiteren 16 PCIe Lanes werden mit PCIe Gen4-Geschwindigkeit (bis zu 256Gb/s Bandbreite) direkt an die CPU angebunden, so dass ein ungebremster Datentransfer zwischen Peripherie und Prozessor möglich ist. Hierbei unterstützt das Modul auch PCIe Bifurcation, was eine Aufsplittung der Schnittstelle für bis zu drei PCIe Root Ports (Modi: x16, x8/x8 oder x8/x4/x4) ohne zusätzliche Elektronik ermöglicht. Besonders für anspruchsvolle Visionanwendungen bietet dies eine hohe Flexibilität. So ist die Anbindung von mehreren PCIe-basierten Kamera-Modulen möglich. Bei Bedarf lassen sich aber auch mehrere Framegrabber oder 10GigE-Controller für hochauflösende High-Speed-Multi-Kamera-Systeme direkt an die CPU anbinden. Alternativ dazu sind weitere Optionen wie Zusatzsteckplätze für mehrere Accelerator-Karten (z.B. für Tensor Processing Units) realisierbar, was ideal für anspruchsvolle KI-Anwendungen ist. Der modulare Ansatz mit dem TQMx110EB, das zusammen mit einem Carrierboard ein vollständiges Bildverarbeitungssystem bildet, bietet somit die Möglichkeit, unterschiedliche Systemarchitekturen zu realisieren, die sich individuell auf die jeweiligen Anforderungen abstimmen lassen und dennoch stets durchgängig höchste Systemperformance bieten. Künstliche Intelligenz (KI) verspricht die Revolution der Fertigung, doch in der Praxis scheitern viele Projekte an einer unzureichenden Datenbasis. Warum Sie erst Ordnung schaffen müssen, bevor Sie Künstliche Intelligenz erfolgreich nutzen können. ‣ weiterlesen

Ohne Datenordnung keine Effizienz: Wie Sie Ihre Produktion KI-ready machen

Embedded-Vision-Lösungen

Die geringe Baugröße des TQMx110EB mit 95x125mm ermöglicht die Integration neuester Intel Core und Intel Xeon Prozessoren in besonders kompakte, aber dennoch extrem leistungsfähige Embedded-Vision-Anwendungen. Da das Modul bereits die volle PC-Funktionalität umfasst, müssen auf dem Carrierboard, welches die Schnittstellen nach außen führt, lediglich noch die individuellen Anforderungen umgesetzt werden. Dabei ist auch eine Optimierung für die spezifischen Einbaubedingungen bezüglich Mechanik und Entwärmung einfach durchführbar. Kompromisse wie beim Einsatz vorgefertigter Gesamtsysteme sind somit nicht notwendig.

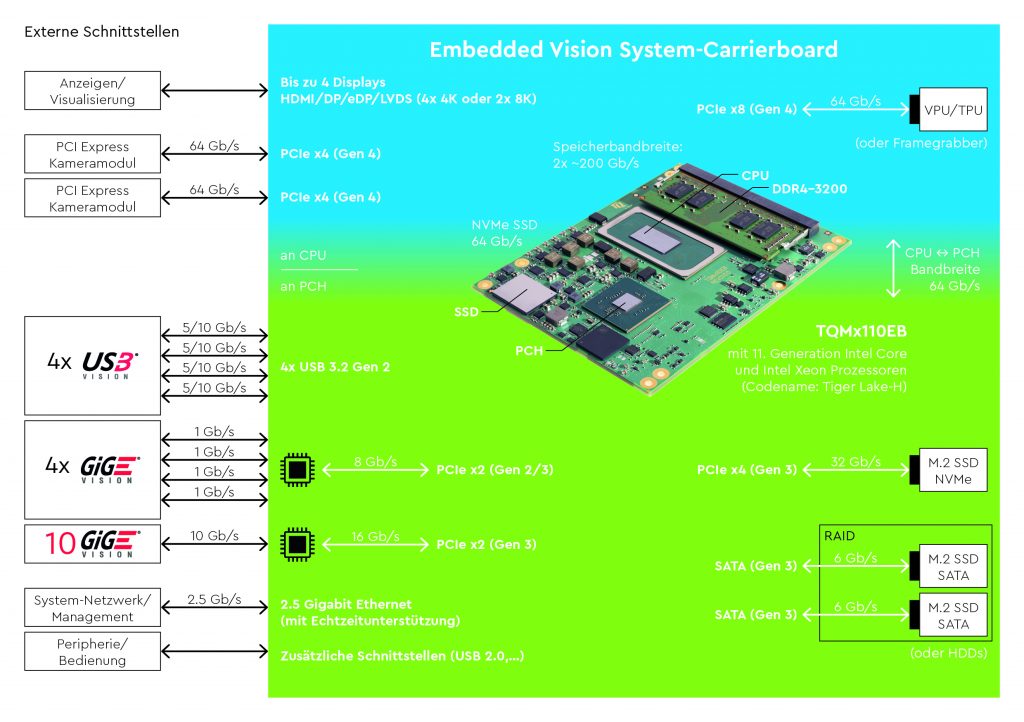

Bild 2 zeigt beispielhaft eine Embedded Vision Lösung mit zwei ultra-hochauflösenden Highspeed-Kameras, die mit hoher Bandbreite über PCIe x4 direkt an die CPU angebunden sind, die zusätzlich auch mit weiteren Kameras erweiterbar ist. Dabei kann es sich auch um eine Mischung aus verschiedenen Interfaces wie USB3 Vision, GigE Vision oder 10GigE Vision handeln. Die ohnehin schon hohe KI-Leistung, die durch die CPU und integrierte Grafik bereitgestellt wird, lässt sich bei Bedarf über einen zusätzlichen AI-Accelerator weiter erhöhen. PCIe x8 Gen4 mit einer Geschwindigkeit von bis zu 128Gb/s stellt dabei ausreichend Bandbreite zur Verfügung, so dass auch besonders leistungsfähige VPUs (Vision Processing Units) oder TPUs (Tensor Processing Units) einsetzbar sind. Durch die Verwendung der auf dem Embedded Modul bereits als Option verfügbaren NVMe x4 SSD steht ein besonders schnelles Speichermedium für das Betriebssystem und die Daten zur Verfügung. Alternativ können auch M.2 Speichermodule (NVMe oder SATA) vorgesehen werden, die zudem auch unterschiedliche RAID-Konfigurationen unterstützen.