Was unterscheidet AugeLab Studio von einer anderen KI-Visionsoftware?

Thomas Schweitzer: AugeLab Studio wurde speziell für die industrielle Bildverarbeitung entwickelt. Im Gegensatz zu generischen KI-Toolkits kombiniert es intuitive Workflows ohne Programmieraufwand mit der Flexibilität von Python-basierten benutzerdefinierten Blöcken. Dies ermöglicht sowohl eine schnelle Prototypenerstellung als auch hochgradig angepasste Lösungen, ohne an ein proprietäres Framework gebunden zu sein. Dies macht KI-Projekte wesentlich zugänglicher und verkürzt die Zeit von der Idee über den Prototyp bis zur Produktionsbereitstellung erheblich. Außerdem unterstützt es gängige industrielle Schnittstellen wie OPC UA, MQTT und TCP/IP und gewährleistet so eine nahtlose Integration in bestehende Automatisierungsumgebungen.

AugeLab Studio läuft auf Standard-Windows- und Linux-PCs sowie auf Embedded Plattformen wie Nvidia Jetson. – Thomas Schweitzer, NotaVis

Wie muss ich mir die Umsetzung eines Projekts und das Training eines KI-Modells vorstellen? Künstliche Intelligenz (KI) verspricht die Revolution der Fertigung, doch in der Praxis scheitern viele Projekte an einer unzureichenden Datenbasis. Warum Sie erst Ordnung schaffen müssen, bevor Sie Künstliche Intelligenz erfolgreich nutzen können. ‣ weiterlesen

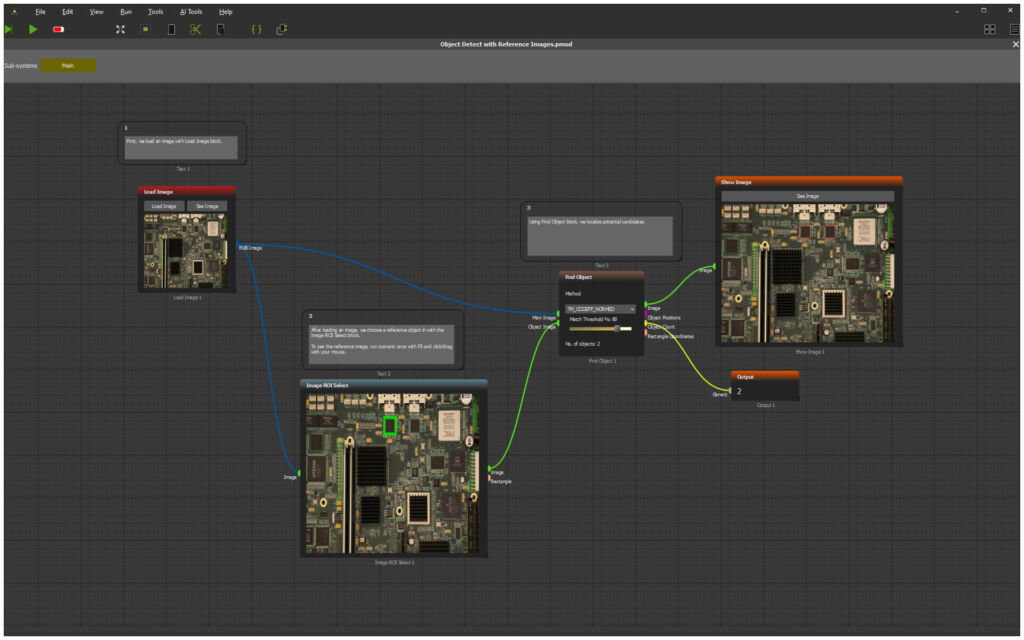

Projekte beginnen in der Regel mit einer klaren Definition der Inspektionsaufgabe, wie z.B. Fehlererkennung, Klassifizierung oder Messung. Mit AugeLab Studio werden Bildakquisitions- und Vorverarbeitungs-Pipelines in einem grafischen Workflow eingerichtet. Für KI-basierte Aufgaben können Datensätze direkt in der Projektumgebung gesammelt und annotiert werden. Das Training der KI-Modelle ist integriert und kann lokal oder auf einem dedizierten GPU-Server durchgeführt werden. Nach dem Training stehen die Modelle sofort für den Einsatz im gleichen Workflow zur Verfügung, womit ein reibungsloser Weg vom Konzept bis zur Produktion gewährleistet ist.

Ohne Datenordnung keine Effizienz: Wie Sie Ihre Produktion KI-ready machen

Welche Tools sind bereits verfügbar?

AugeLab Studio wird mit einer wachsenden Anzahl einsatzbereiter Tools geliefert, darunter klassische Visionfunktionen (Filterung, Schwellenwertbildung, Kantenerkennung), KI-basierte Objekterkennung und -segmentierung (Yolo, Segment Anything, benutzerdefinierte Modelle), Datenverarbeitung und Automatisierung (Datei-I/O, Protokollierung, Anbindung an SPS und MES), Entwicklung benutzerdefinierter Blöcke mit Python für projektspezifische Logik sowie Visualisierungs- und Debugging-Tools für eine transparente Projektvalidierung.

Auf welchen Plattformen und Betriebssystemen läuft die Software?

Die Software läuft auf Standard-Windows- und Linux-PCs sowie auf Embedded Plattformen wie Nvidia Jetson. Dies ermöglicht eine flexible Skalierung – von Edge-KI-Geräten bis hin zu Servern.

Für welche Anwendungen eignet sich die Software besonders?

AugeLab Studio eignet sich besonders für industrielle Anwendungsfälle, in denen Flexibilität und schnelle Bereitstellung entscheidend sind, wie z.B. Qualitätsprüfung (Oberflächenfehler, Montagefehler, Kratzer, Risse), Mess- und Ausrichtungsaufgaben (Positionierung, Maßprüfung), Objekterkennung und -klassifizierung (Sortierung, Verpackung, Logistik) sowie Material- und oberflächenspezifische Prüfung (Kunststoffe, Holz, Metalle, Glas).

Zu den wichtigsten Aspekten der KI in AugeLab Studio gehören:

- Integrierte Datensatzverwaltung: Bilder können direkt in der Umgebung gesammelt, beschriftet und organisiert werden, was die Vorbereitung von Datensätzen äußerst effizient macht.

- Individuelles Modelltraining: Benutzer können eigenen Modelle (Klassifizierung, Erkennung, Segmentierung) trainieren, ohne die Plattform verlassen zu müssen. Das Training kann auf lokalen GPUs oder externen Servern durchgeführt werden.

- Vortrainierte Modelle: Gebrauchsfertige KI-Modelle (z.B. Yolo, Segment Anything, OCR) sind bereits enthalten und können für spezifische Anwendungsfälle fein abgestimmt werden.

- Hybride Pipelines: KI-Blöcke können mit klassischen Bildverarbeitungsfunktionen (Filter, Messungen, Merkmalsextraktion) in einem Workflow kombiniert werden.

- Bereitstellung ohne Konvertierung: Sobald ein Modell trainiert ist, kann es sofort im selben Projekt eingesetzt werden. Es sind keine externen Export-, Konvertierungs- oder Integrationsschritte erforderlich.

- Kontinuierliche Verbesserung: Der KI-Workflow unterstützt iterative Verbesserungen, das heißt neue Bilder können zum Datensatz hinzugefügt, das Training neu gestartet und aktualisierte Modelle live in der Produktion getestet werden.