2026 markiert für viele Unternehmen einen strategischen Wendepunkt. Zentrale Zukunftstechnologien – von Künstlicher Intelligenz über Edge-Computing bis hin zu modernen Datenplattformen – wachsen zu smarten Systemen zusammen. Parallel steigen die Anforderungen an die IT-Infrastruktur deutlich. Dell Technologies zeigt drei Entwicklungen, die 2026 maßgeblich bestimmen und Einfluss auf die Planungs- und Investitionsstrategien von Unternehmen nehmen werden.

Trend Nr. 1: Die IT-Umgebung wandelt sich zur modularen KI-Fabrik

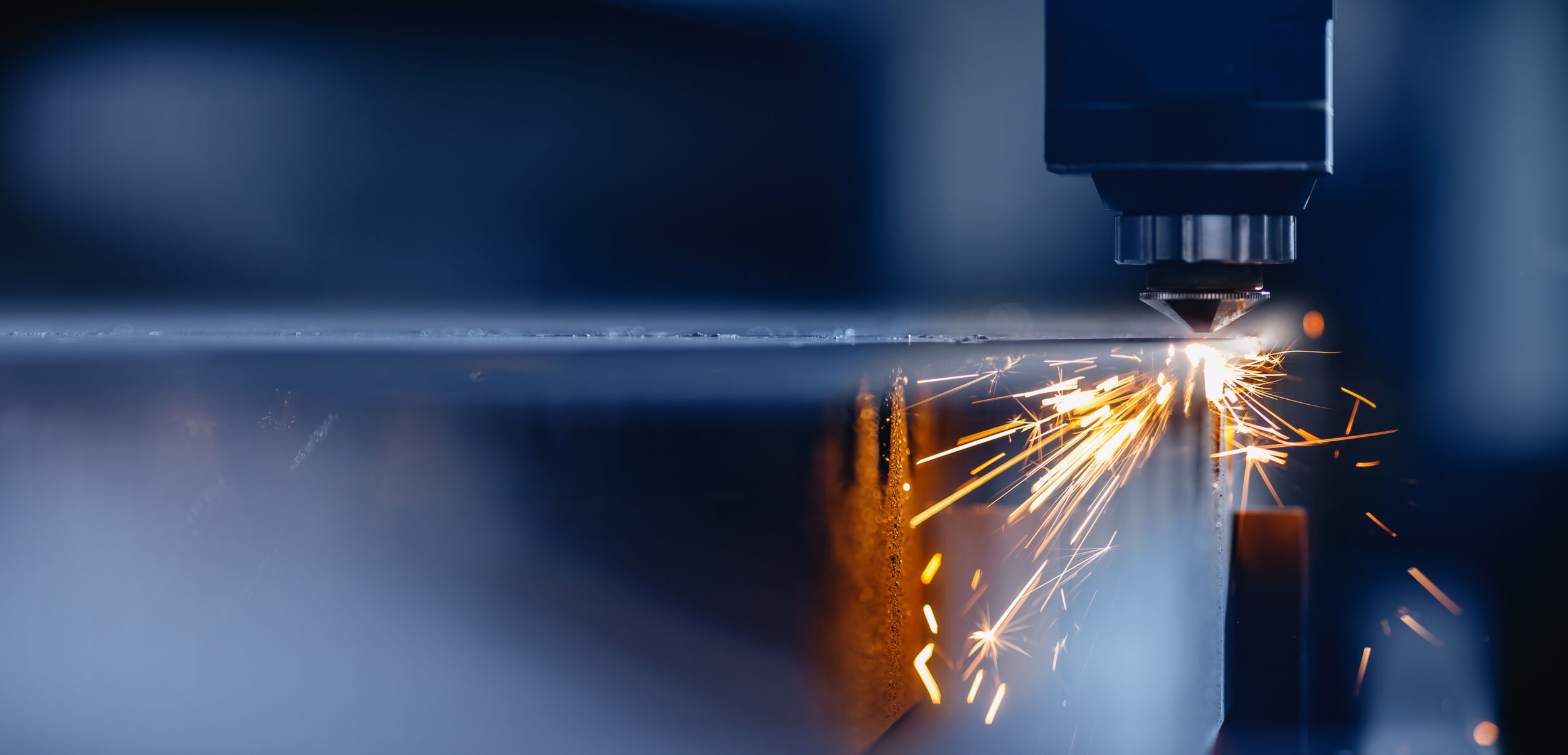

Durch ‚Data Center as a Service‘ können Unternehmen Zugang zu Rechenleistung auf spezialisierter IT erhalten, ohne selbst eine Infrastruktur aufbauen zu müssen. Grundsätzlich hat sich ein hybrider Ansatz bewährt, mit dem sich die Firmen eine Art ‚KI-Fabrik‘ aufbauen können. Edge-Systeme übernehmen latenzkritische Aufgaben, zentrale Rechenumgebungen dienen als Trainings- und Managementschicht, während Public-Cloud-Kapazitäten bei weniger sensiblen Informationen zur elastischen Skalierung genutzt werden. Während klassische Anwendungen meist vorhersehbare Rechenlasten erzeugen, variieren KI-Workloads extrem stark. Um ihre digitale Souveränität auszubauen, müssen Datenverarbeitung und Modelltraining so gestaltet sein, dass Unternehmen ihre Wertschöpfungskette jederzeit selbst kontrollieren können. Künstliche Intelligenz (KI) verspricht die Revolution der Fertigung, doch in der Praxis scheitern viele Projekte an einer unzureichenden Datenbasis. Warum Sie erst Ordnung schaffen müssen, bevor Sie Künstliche Intelligenz erfolgreich nutzen können. ‣ weiterlesen

Ohne Datenordnung keine Effizienz: Wie Sie Ihre Produktion KI-ready machen

Trend Nr. 2: Die KI-Ökonomie erzwingt ein Umdenken bei der Speicherlösung

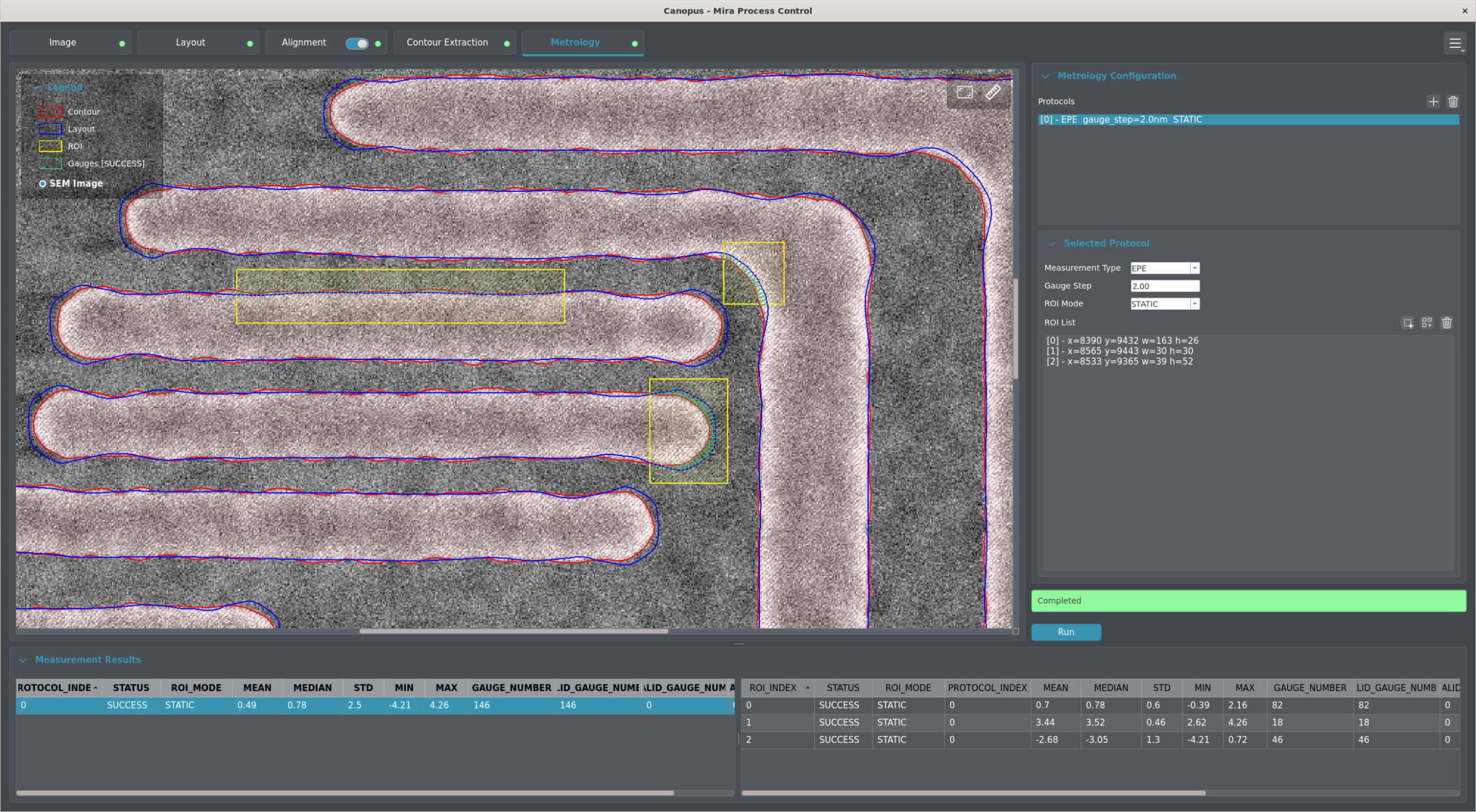

Um die Effizienz des gesamten KI-Stacks zu gewährleisten, ist eine gute Storage-Umgebung essentiell. Durch disaggregierte Architekturen können Modellaufrufe, Retrieval-Vorgänge und Validierungen so organisiert werden, dass das System nicht nur exakt, sondern auch ressourcenschonend arbeitet. Hierbei sind Storage- und Compute-Leitungen entkoppelt. Über ein Netzwerk steht eine gemeinsame Speicherebene bereit, die von allen Systemen gleichzeitig genutzt werden kann. Klassische Speicherarchitekturen wie NAS, SAN oder ältere Direct-Attached Storage sowie hyperkonvergente Infrastrukturen stoßen stattdessen schnell an ihre Grenzen.

Trend Nr. 3: Kleine Modelle bringen Intelligenz tief in den operativen Kern

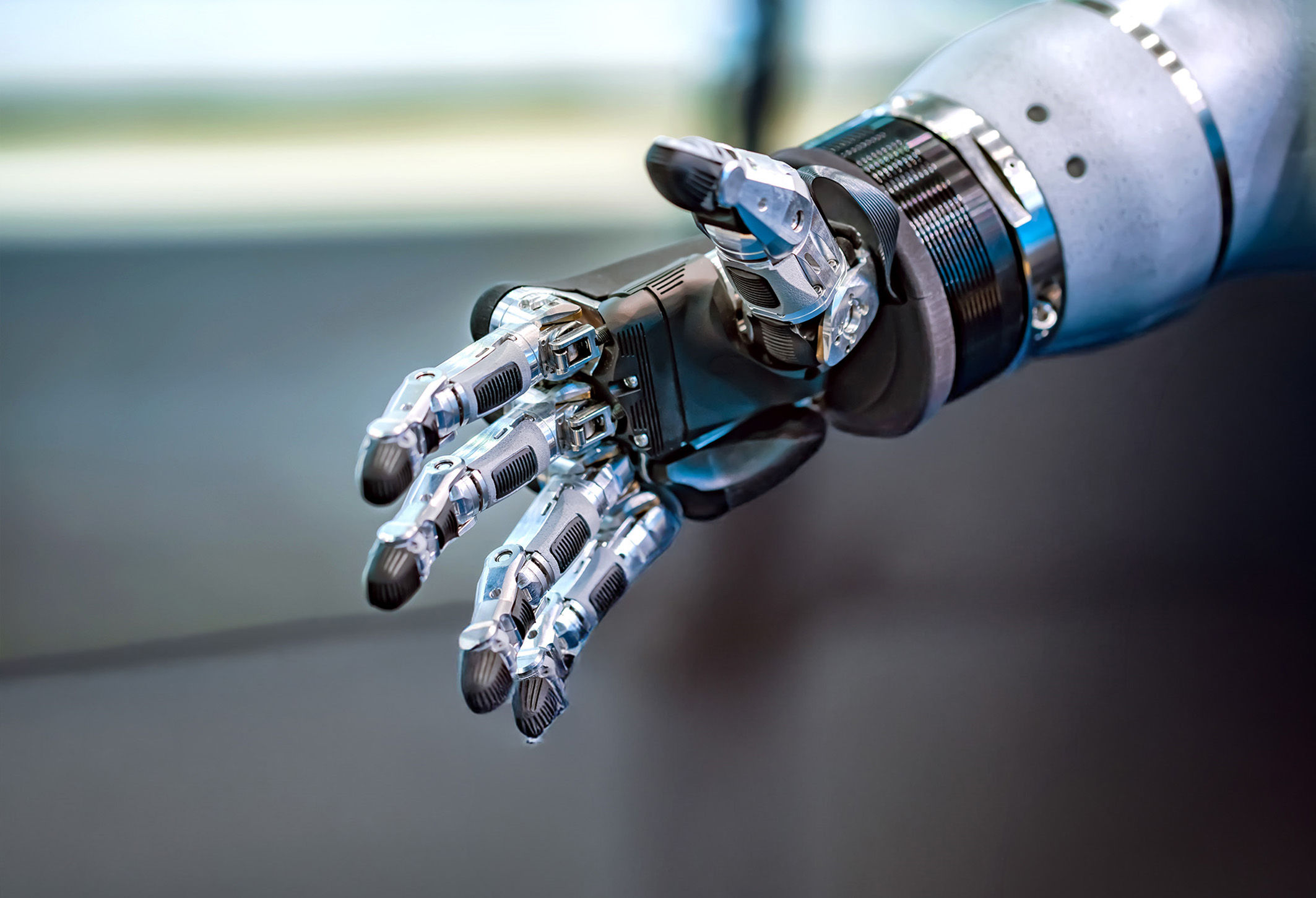

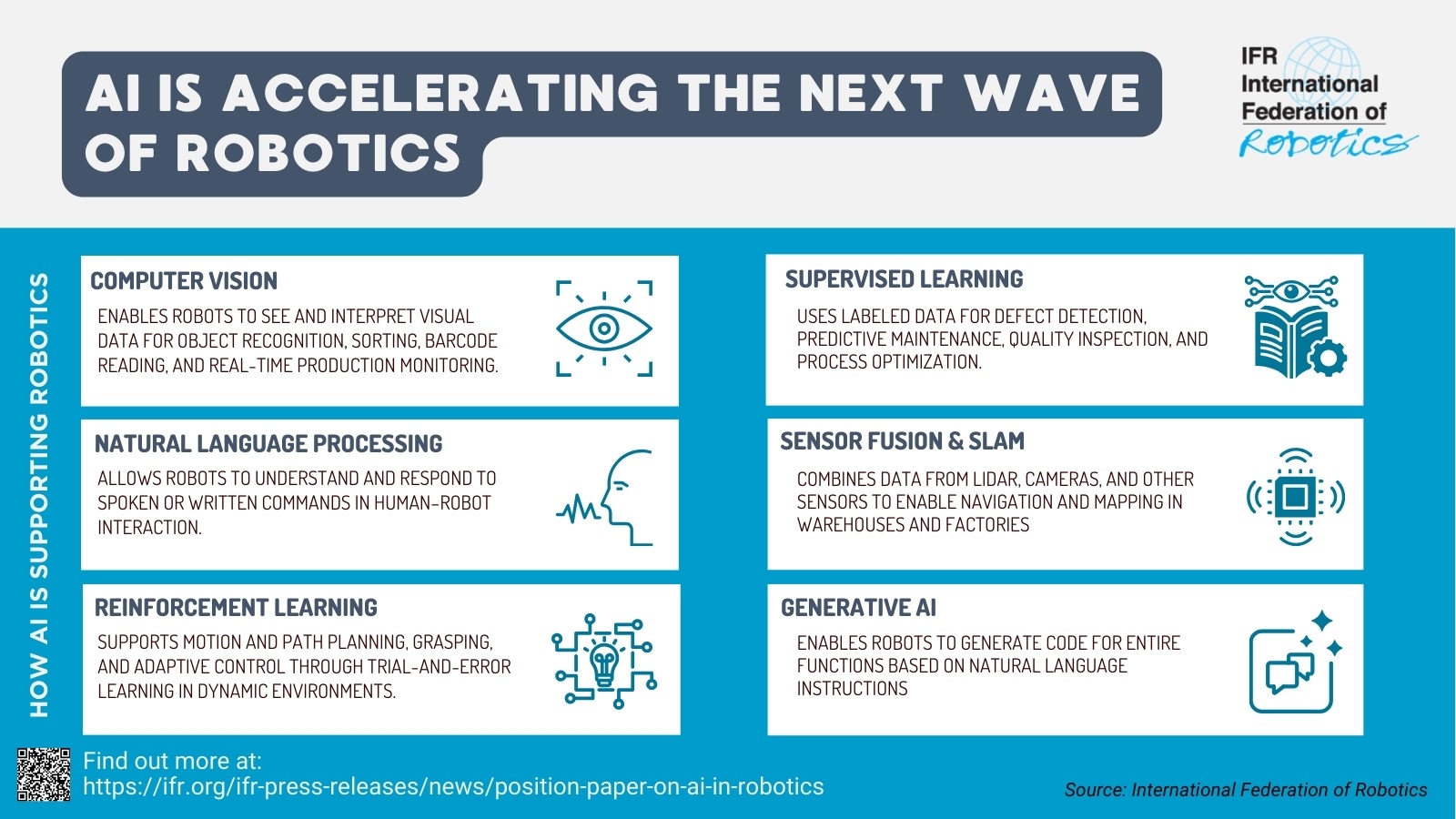

Im Gegensatz zu großen KI-Sprachmodellen lassen sich Small Language Models (SLMs) schnell in die Produktionsprozesse integrieren und innerhalb weniger GPU-Stunden für spezifische Aufgaben, wie das Erkennen von Abweichungen oder das Auswerten von Wartungsberichten, trainieren. Techniken wie die Low-Rank Adaptation (LoRA) helfen dabei, indem sie dedizierte Arbeitsbereiche integrieren, ohne das gesamte Modell neu schulen zu müssen. SLMs können direkt auf Edge-Geräten oder in abgeschotteten OT-Umgebungen betrieben werden, wodurch Reaktionszeiten und Sicherheitsrisiken minimiert werden. Zudem sinken durch SLMs Rechenaufwand, Energieverbrauch und Cloud-Kosten. Gerade für Anwendungen im Bereich der Physical AI sind solche kompakten Modelle unverzichtbar, denn selbstlernende, autonome Roboter würden ohne eingebettete Intelligenz nicht funktionieren.

„2026 wird ein Jahr, in dem Unternehmen nicht mehr fragen, ob sie KI einsetzen, sondern wie sie ihre technischen und operativen Strukturen neu denken müssen, damit alles so funktioniert, dass Wertschöpfung entsteht“, sagt Tim van Wasen, Geschäftsführer von Dell Technologies DACH. „KI stellt dabei hohe Anforderungen an die IT-Umgebung. Das bedeutet auch, dass Unternehmen die richtige Balance zwischen Geschwindigkeit, Sicherheit und Kosten finden müssen, um die unterschiedlichsten Prioritäten und Ansprüche in Einklang zu bringen.“