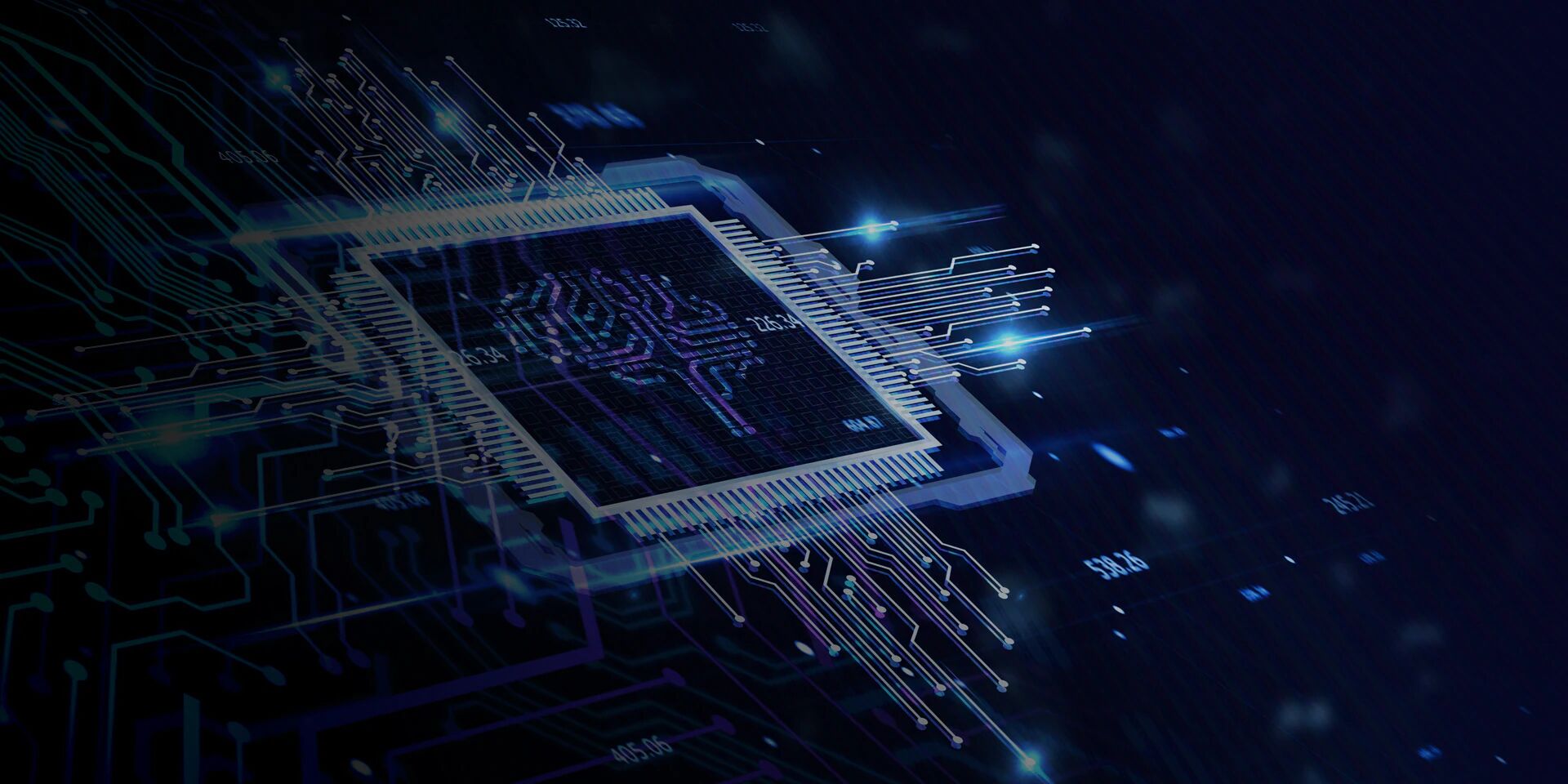

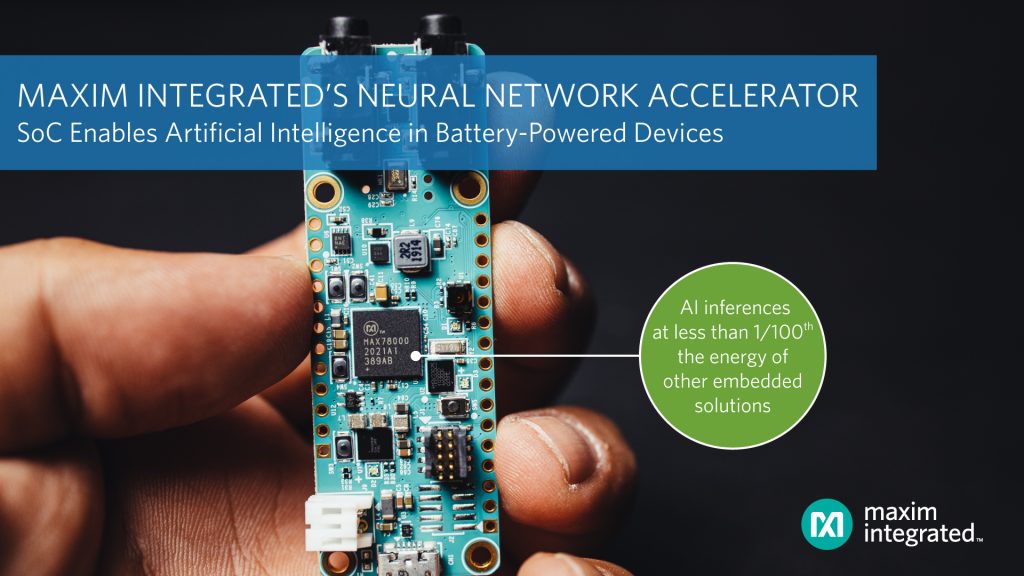

Der Low-Power-Neuronale-Netzwerk-Beschleuniger-Mikrocontroller Max78000 von Maxim Integrated Products bringt ohne Leistungseinbußen bei batteriebetriebenen Internet-of-Things-Geräten die Künstliche Intelligenz (KI) an die Edge. Der Baustein erlaubt die Ausführung von KI-Inferenzen mit weniger als einem Hundertstel der Energie, die konventionelle Softwarelösungen benötigen. Damit erhöht er ganz erheblich die Laufzeit batteriebetriebener KI-Applikationen und ermöglicht auch komplexe neue KI-Anwendungen, die zuvor als nicht realisierbar galten. Diese Leistungsverbesserungen fordern keinerlei Kompromisse hinsichtlich Latenz und Kosten: Der Max78000 führt Inferenzen 100x schneller aus als Softwarelösungen, die auf Low-Power-Mikrocontrollern laufen und das zu einem Bruchteil der Kosten von FPGA- oder GPU-Lösungen.

Durch die Integration eines dedizierten neuronalen Netzwerkbeschleunigers mit zwei verschiedenen Mikrocontroller-Kernen hebt der Max78000 diese Einschränkungen auf. Er ermöglicht es Maschinen, komplexe Muster optisch und akustisch wahrzunehmen – mit lokaler und in Echtzeit ausgeführter KI-Verarbeitung bei geringer Leistungsaufnahme. Anwendungen wie industrielle Bildverarbeitung, Audio- und Gesichtserkennung können effizienter gestaltet werden, da der Max78000 Inferenzen mit weniger als einem Hundertstel der von einem Mikrocontroller benötigten Energie ausführen kann. Herzstück des Max78000 ist eine spezialisierte Hardware, die darauf ausgelegt ist, die Leistungsaufnahme und die Latenzzeit von Convolutional Neural Networks (CNN) zu minimieren.

Diese Hardware läuft, ohne dass die Mikrocontroller-Kerne stark eingreifen müssen, wodurch der Betrieb extrem optimiert ist. Energie und Zeit werden nur für die mathematischen Operationen aufgewendet, die ein CNN implementieren. Um externe Daten effizient in die CNN-Engine zu übertragen, können Kunden einen der beiden integrierten Mikrocontroller-Kerne verwenden: den Ultra-Low Power Arm Cortex-M4-Kern oder den RISC-V-Kern mit einer noch niedrigeren Leistungsaufnahme.