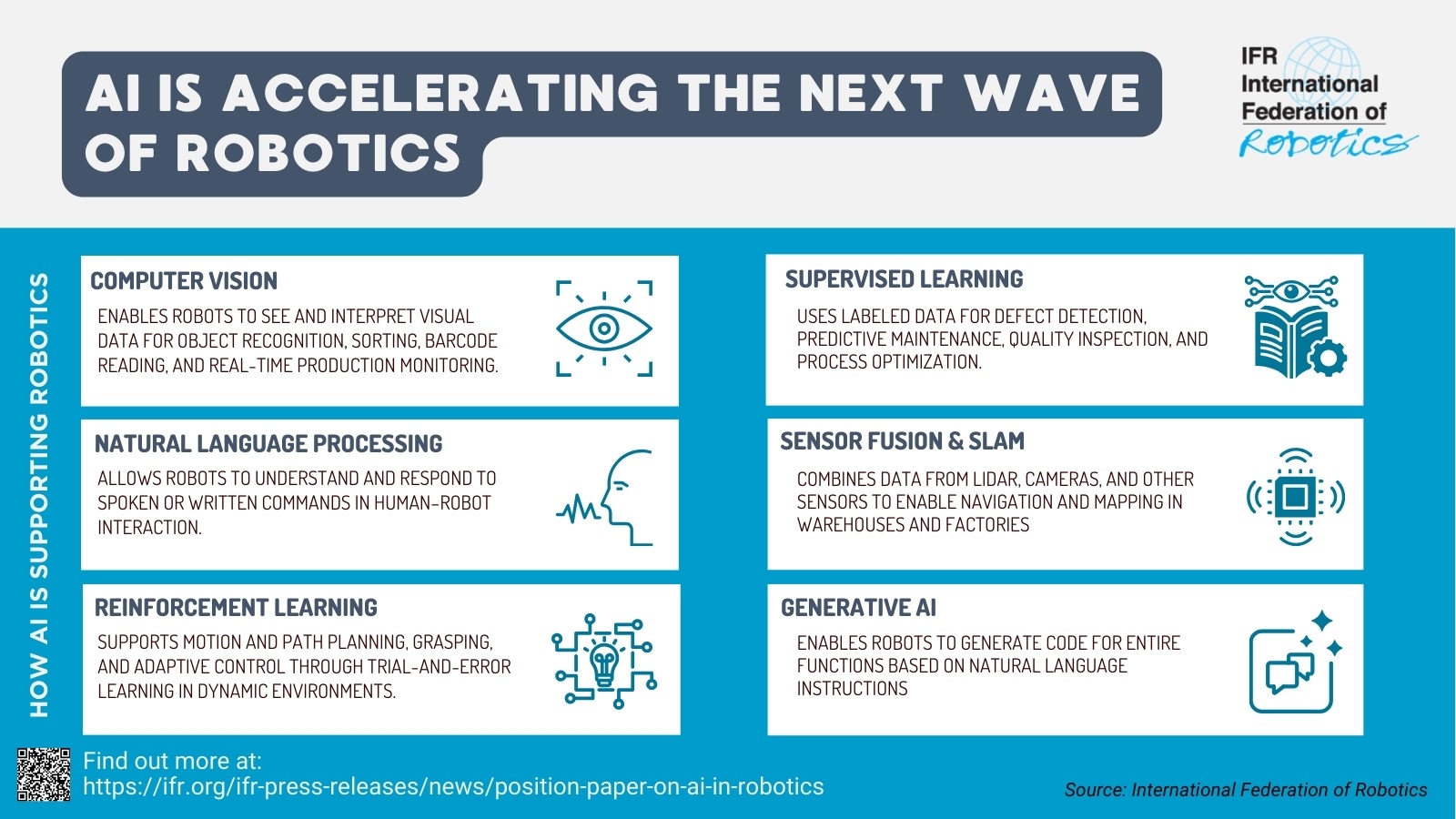

Für den Einsatz von künstlicher Intelligenz in der Industrie wird künftig nicht mehr allein die Leistungsfähigkeit entscheidend sein. Vielmehr rücken der Nachweis korrekter Ergebnisse und deren Glaubwürdigkeit in den Vordergrund.

„Wir erleben einen strukturellen Wandel. KI-Systeme liefern zunehmend stabile und korrekte Ergebnisse. Doch ihre innere Logik bleibt häufig verborgen“, sagt Jens Rollenmüller, Regional Vice President bei Aras. Gerade in sicherheitskritischen, regulierten und haftungsrelevanten Umgebungen ist das nicht akzeptabel, egal ob Industrieproduktion, Mobilität, Medizintechnik oder Verteidigung. „KI kann sich nur dort durchsetzen, wo ihre Entscheidungsgrundlagen erklärbar, überprüfbar und verantwortbar sind. 2026 wird das Jahr, in dem diese Erwartung zum neuen Standard wird“, so Rollenmüller weiter. Künstliche Intelligenz (KI) verspricht die Revolution der Fertigung, doch in der Praxis scheitern viele Projekte an einer unzureichenden Datenbasis. Warum Sie erst Ordnung schaffen müssen, bevor Sie Künstliche Intelligenz erfolgreich nutzen können. ‣ weiterlesen

Ohne Datenordnung keine Effizienz: Wie Sie Ihre Produktion KI-ready machen

Neue regulatorische Rahmenbedingungen beschleunigen diese Entwicklung. Mit der schrittweisen Einführung des EU AI Act und des Digital Product Passport (DPP) steigen die Anforderungen an Transparenz und Nachweisbarkeit deutlich.

PLM wird vom Werkzeug zur Vertrauensinfrastruktur

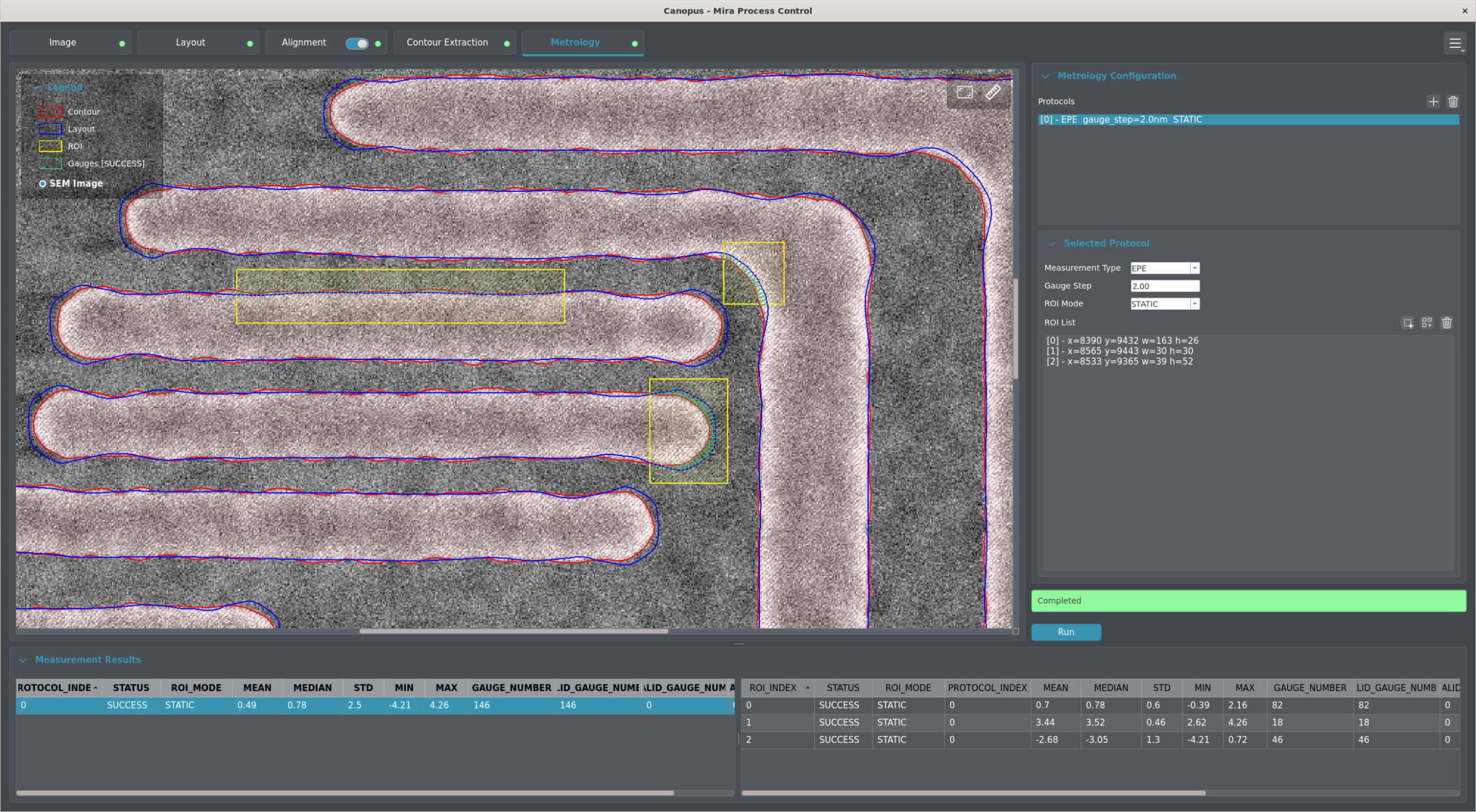

Die Architektur industrieller Informationssysteme rückt vor diesem Hintergrund stärker in den Fokus. Vertrauen entsteht nicht durch Absichtserklärungen, sondern durch belastbare Strukturen. Dabei übernimmt das Product Lifecycle Management (PLM) eine strategische Rolle: „Der vom PLM zur Verfügung gestellte Digital Thread entwickelt sich zum Rückgrat vertrauenswürdiger KI-Nutzung. Als ‚Product Memory‘ verbindet er Daten, Entscheidungen, Tests und Änderungen über den Produktlebenszyklus hinweg und schafft die Voraussetzung, KI-Ergebnisse zu prüfen, zu reproduzieren und zu auditieren“, erklärt Rollenmüller. „PLM rückt somit von einem Werkzeug der Produktentwicklung zu einer zentralen Vertrauensinfrastruktur auf.“ PLM-Systeme entwickeln sich damit auch funktional weiter: weg von reiner Dokumentation, hin zu aktiver Orientierung.